터보퀀트: 왜 모두가 ‘KV 캐시’를 줄이려 하는가

Document AI 기업 사이냅소프트입니다.

사이냅 OCR IX에 적용된 구글의 최신 양자화 기술 ‘터보퀀트(TurboQuant)’가 어떤 맥락에서 등장했고, 왜 의미가 있는지 짚어봅니다.

01.AI의 기억력은 좋아지고, GPU의 부담도 커진다

지난 2~3년 사이 AI는 비약적으로 기억력이 좋아졌습니다.

몇 해 전엔 1만 토큰만 다뤄도 길다고 했는데, 지금은 12만 토큰이 표준이고 일부 모델은 100만 토큰까지 한 번에 읽고 기억합니다.

토큰은 AI가 한 번에 처리할 수 있는 내용의 양입니다.

덕분에 수백 페이지짜리 약관·재무제표를 한 번에 분석하거나, 대규모 RAG에서 수십 개 문서를 한꺼번에 비교하거나, 멀티턴 대화에서 수십 차례 오간 내용을 잊지 않고 유지하는 일이 가능해졌습니다.

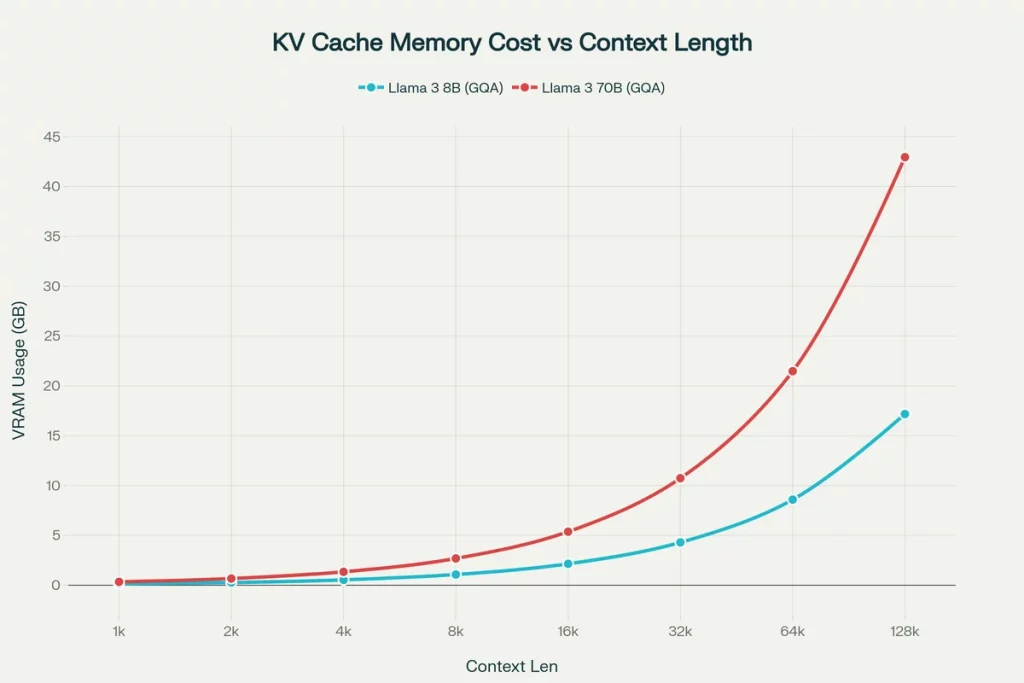

컨텍스트 길이가 길어지면 VRAM 사용량도 늘어나는 것을 Llama 3모델로 보여주는 그래프

문제는 기억이 길어질수록 GPU가 감당해야 할 메모리 비용도 함께 불어난다는 점입니다. 그 핵심에 있는 것이 바로 KV 캐시(Key-Value Cache)입니다.

KV 캐시란

LLM은 답을 한 단어씩 만들어내면서, 앞에서 한 말을 일종의 ‘단기 기억‘에 저장해두고 재사용합니다. 이것이 KV 캐시입니다.

그런데 이 단기 기억은 문맥이 길수록 비례해서 늘어나는 구조입니다.

700억 파라미터급 모델로 12만 8천 토큰 문서를 처리하면, 사용자 한 명을 위한 단기 기억만으로 GPU 한 장의 메모리 절반 가까이가 채워집니다.

동시 사용자 32명이라면 합쳐 640GB. 어느 순간 모델 자체보다 단기 기억이 더 무거워지는 역전 현상이 벌어집니다.

문서 AI는 이 한계에 가장 먼저 부딪힌다

이 문제는 시각언어모델(VLM) 기반 문서 AI에서 한층 심화됩니다.

이미지 한 장이 토큰으로 환산되면 텍스트보다 훨씬 많기 때문입니다.

즉, 문서 AI는 KV 캐시 압력에 가장 먼저 부딪히는 영역입니다.

약관, 재무제표, 행정 서식, 판례 같은 길고 복잡한 문서들은 이 병목의 한가운데에 있습니다.

KV 캐시 압축에 대한 연구

그래서 2024~2025년 학계·업계의 인기 주제 중 하나가 KV 캐시 압축이었습니다. 그리고 2026년 초, 그 흐름의 한복판에 등장한 것이 바로 터보퀀트(TurboQuant) 입니다.

02. 터보퀀트가 한 일

구글 리서치가 ICLR 2026에 공개한 터보퀀트의 핵심은 한 줄로 정리됩니다.

벡터의 정밀도는 적당히 포기하되, 어텐션이 실제로 필요로 하는 ‘중요도 순서‘는 그대로 보존한다.

기존 기법들은 KV 캐시 비트 수를 줄이려다 정확도를 함께 잃거나, 메타데이터 오버헤드 때문에 압축률에 한계가 있었습니다.

터보퀀트는 두 단계 접근으로 이를 풉니다.

벡터 분포를 회전·재배치해 효율적으로 압축하고(PolarQuant), 그 과정의 미세한 오차를 1비트짜리 수학적 보정 장치(QJL)로 통계적으로 상쇄하는 방식입니다.

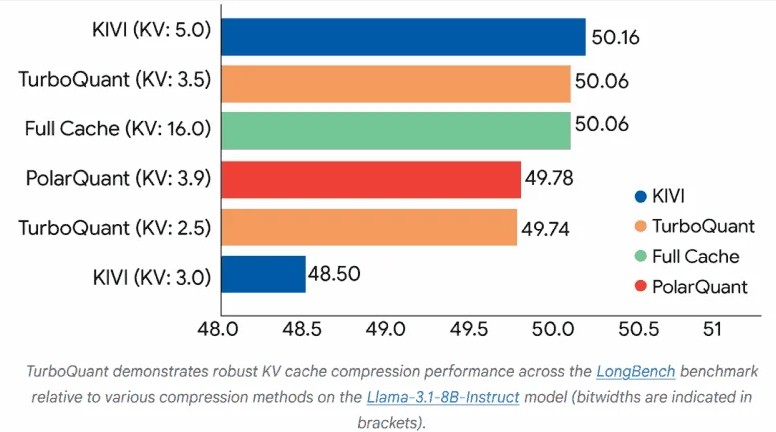

구글이 공개한 수치는 다음과 같습니다.

구글 리서치가 밝힌 터보퀀트의 벤치마크 테스트 결과. (자료 출처=구글 리서치)

- KV 캐시 메모리 최소 6배 절감 (3비트 기준)

- 어텐션 연산 최대 8배 가속 (4비트, NVIDIA H100)

- 약 3.5비트/채널에서 FP16과 동등한 품질 (LongBench·NIAH·RULER)

별도의 학습이나 캘리브레이션 없이 어떤 트랜스포머 모델에든 즉시 얹을 수 있다는 점도 강점입니다.

발표 직후 “AI 추론 비용 구조 자체를 바꿀 수 있는 알고리즘“이라는 평가가 잇따르며, GPU 수요 전망이 다시 쓰이는 계기로까지 거론됐습니다.

03. 사이냅 OCR IX의 빠른 적용

사이냅소프트는 이런 흐름 속에서 터보퀀트를 사이냅 OCR IX의 VLM 엔진에 빠르게 적용했습니다.

동일 GPU 환경에서 더 긴 컨텍스트와 더 큰 배치를 안정적으로 처리할 수 있게 되어, 고가의 고성능 GPU 서버 부담이 컸던 고객들의 TCO(총소유비용)를 낮추는 데 직접적으로 기여합니다.

여기에 더해 ‘사이냅 OCR IX CPU 버전‘ 도 함께 지원합니다.

자체 개발 모델 특성에 맞춘 정밀 프로파일링으로 품질 손실은 1% 이하로 억제하면서, CPU 서버만으로 분당 약 100건 수준의 추론 처리가 가능합니다.

망분리·온프레미스 구축이 일반적인 금융·공공 부문, 그리고 GPU 추가 도입이 부담스러운 기업에게 의미 있는 선택지입니다.

04.마치며

터보퀀트는 2026년 초 가장 주목받은 AI 인프라 알고리즘이지만, “공개됐다고 바로 쓸 수 있는 기술“은 아닙니다.

사이냅소프트가 발 빠르게 반영할 수 있었던 것은, 25년간 논문과 실제 서비스 사이의 간극을 메우는 엔지니어링을 해온 배경이 있기 때문입니다.

긴 문서를 더 적은 비용으로, 더 안정적으로 다루고 싶으신 분들께 사이냅 OCR IX는 좋은 답이 될 수 있습니다.

관심이 있으시다면 다음의 글을 함께 참조해주세요.

- TurboQuant 논문 (Google Research, ICLR 2026): arxiv.org/abs/2504.19874

- 사이냅소프트 보도자료: 구글 최신 AI 기술 ‘터보퀀트’ 가장 빠르게 적용

- 사이냅 OCR IX 제품 페이지: synapsoft.co.kr/ocr